Initial commit

This commit is contained in:

92

tools/blog/README.md

Normal file

92

tools/blog/README.md

Normal file

@@ -0,0 +1,92 @@

|

||||

# 知乎博客HTML解析工具

|

||||

|

||||

## 功能说明

|

||||

|

||||

该工具用于将下载的知乎博客HTML文件解析为标准Markdown格式,方便后续编辑和管理。

|

||||

|

||||

- 支持提取文章标题

|

||||

- 支持提取正文内容(段落、图片、代码块等)

|

||||

- 支持将HTML元素转换为对应的Markdown格式

|

||||

- 自动生成同名的.md文件

|

||||

|

||||

## 安装依赖

|

||||

|

||||

在使用前,需要安装以下依赖库:

|

||||

|

||||

```bash

|

||||

pip install -r requirements.txt

|

||||

```

|

||||

|

||||

依赖库说明:

|

||||

- `beautifulsoup4` - 用于解析HTML结构

|

||||

- `lxml` - 作为BeautifulSoup的解析器

|

||||

- `markdownify` - 用于将HTML转换为Markdown

|

||||

|

||||

## 使用方法

|

||||

|

||||

### 基本用法

|

||||

|

||||

```bash

|

||||

python parse_blog.py <html_file_path>

|

||||

```

|

||||

|

||||

例如:

|

||||

|

||||

```bash

|

||||

python parse_blog.py "(6 封私信 _ 14 条消息) 高质量Mesh体积光渲染 - 知乎.html"

|

||||

```

|

||||

|

||||

### 输出结果

|

||||

|

||||

执行命令后,工具会在同一目录下生成同名的.md文件,例如:

|

||||

- 输入:`(6 封私信 _ 14 条消息) 高质量Mesh体积光渲染 - 知乎.html`

|

||||

- 输出:`(6 封私信 _ 14 条消息) 高质量Mesh体积光渲染 - 知乎.md`

|

||||

|

||||

## 支持的元素

|

||||

|

||||

- 标题(h1-h6)

|

||||

- 段落(p)

|

||||

- 图片(img)

|

||||

- 代码块(pre code)

|

||||

- 引用块(blockquote)

|

||||

- 列表(ul, ol)

|

||||

- 链接(a)

|

||||

|

||||

## 注意事项

|

||||

|

||||

1. 该工具仅支持解析知乎博客HTML文件,其他网站的HTML可能无法正确解析

|

||||

2. 为了获得最佳解析效果,建议使用浏览器的"保存页面为HTML"功能下载完整的HTML文件

|

||||

3. 解析过程中可能会遇到一些特殊元素无法完全转换,此时会使用默认处理方式

|

||||

|

||||

## 故障排除

|

||||

|

||||

如果遇到解析失败的情况,可以尝试以下方法:

|

||||

|

||||

1. 确保HTML文件是完整的,包含所有必要的结构

|

||||

2. 检查是否已正确安装所有依赖库

|

||||

3. 查看命令行输出的错误信息,根据提示进行修复

|

||||

|

||||

## 示例

|

||||

|

||||

### 输入输出示例

|

||||

|

||||

**输入**:知乎HTML文件

|

||||

**输出**:

|

||||

|

||||

```markdown

|

||||

# 高质量Mesh体积光渲染

|

||||

|

||||

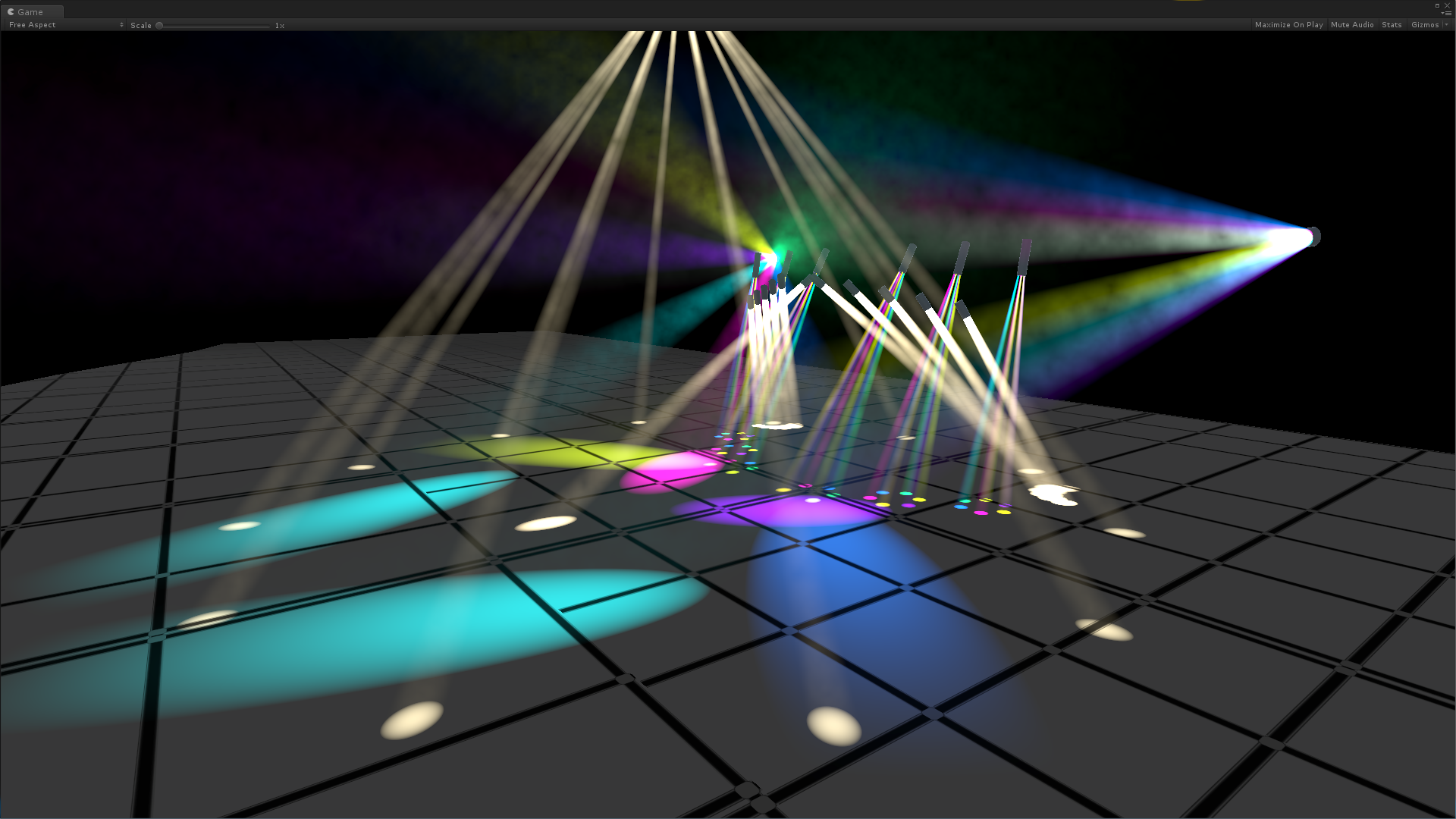

SpotLight是Unity里面常用的灯光类型,我们渲染它的时候按照生活常识来说需要渲染两个部分,一个是照亮东西的效果,如下图:

|

||||

|

||||

|

||||

|

||||

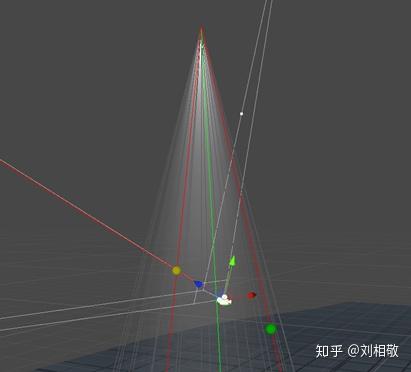

另外一个当然就是舞台上经常看到的光柱效果,学名叫体积光,如下图所示:

|

||||

|

||||

|

||||

|

||||

这篇文章就主要讲一下如何实现高质量的体积光效果。

|

||||

```

|

||||

|

||||

## 许可证

|

||||

|

||||

本工具采用MIT许可证,可自由使用和修改。

|

||||

160

tools/blog/parse_blog.py

Normal file

160

tools/blog/parse_blog.py

Normal file

@@ -0,0 +1,160 @@

|

||||

#!/usr/bin/env python3

|

||||

# -*- coding: utf-8 -*-

|

||||

"""

|

||||

知乎博客HTML解析为Markdown工具

|

||||

|

||||

功能:将下载的知乎HTML文件解析为标准Markdown格式

|

||||

使用:python parse_blog.py <html_file_path>

|

||||

"""

|

||||

|

||||

import os

|

||||

import sys

|

||||

from bs4 import BeautifulSoup

|

||||

from markdownify import markdownify as md

|

||||

|

||||

|

||||

def parse_zhihu_blog(html_file):

|

||||

"""

|

||||

解析知乎博客HTML文件并转换为Markdown

|

||||

|

||||

Args:

|

||||

html_file: HTML文件路径

|

||||

|

||||

Returns:

|

||||

str: 转换后的Markdown内容

|

||||

"""

|

||||

try:

|

||||

# 读取HTML文件

|

||||

with open(html_file, 'r', encoding='utf-8') as f:

|

||||

html_content = f.read()

|

||||

|

||||

# 解析HTML

|

||||

soup = BeautifulSoup(html_content, 'lxml')

|

||||

|

||||

# 提取标题

|

||||

title = ""

|

||||

title_tag = soup.find('h1', class_='Post-Title')

|

||||

if not title_tag:

|

||||

title_tag = soup.find('h1')

|

||||

if title_tag:

|

||||

title = title_tag.get_text(strip=True)

|

||||

|

||||

# 提取正文内容

|

||||

content = ""

|

||||

|

||||

# 知乎文章正文的常见容器

|

||||

content_containers = [

|

||||

soup.find('div', class_='Post-RichTextContainer'),

|

||||

soup.find('div', class_='RichText ztext Post-RichText'),

|

||||

soup.find('article', class_='Post-content'),

|

||||

soup.find('div', class_='Post-content')

|

||||

]

|

||||

|

||||

# 尝试找到第一个有效的内容容器

|

||||

content_container = None

|

||||

for container in content_containers:

|

||||

if container:

|

||||

content_container = container

|

||||

break

|

||||

|

||||

# 如果找到了内容容器,提取内容

|

||||

if content_container:

|

||||

# 预处理:移除不需要的元素

|

||||

for element in content_container.find_all(['script', 'style', 'iframe', 'noscript']):

|

||||

element.decompose()

|

||||

|

||||

# 处理图片路径

|

||||

for img in content_container.find_all('img'):

|

||||

if 'src' in img.attrs:

|

||||

src = img['src']

|

||||

# 处理相对路径

|

||||

if src.startswith('./'):

|

||||

# 保持相对路径不变

|

||||

pass

|

||||

# 处理绝对路径

|

||||

elif src.startswith('http'):

|

||||

# 保持绝对路径不变

|

||||

pass

|

||||

|

||||

# 处理链接

|

||||

for a in content_container.find_all('a'):

|

||||

if 'href' in a.attrs:

|

||||

href = a['href']

|

||||

# 处理知乎内部链接

|

||||

if href.startswith('/'):

|

||||

a['href'] = f"https://www.zhihu.com{href}"

|

||||

|

||||

# 转换为Markdown

|

||||

content = md(str(content_container),

|

||||

heading_style="ATX",

|

||||

code_language="",

|

||||

wrap_width=0)

|

||||

else:

|

||||

# 如果没有找到特定容器,尝试提取所有p标签内容

|

||||

paragraphs = soup.find_all('p')

|

||||

content = "\n".join([p.get_text(strip=True) for p in paragraphs])

|

||||

|

||||

# 后处理:清理Markdown内容

|

||||

# 移除多余的空行

|

||||

content = '\n'.join([line for line in content.split('\n') if line.strip() or line == ''])

|

||||

# 清理重复的换行

|

||||

while '\n\n\n' in content:

|

||||

content = content.replace('\n\n\n', '\n\n')

|

||||

|

||||

# 组合标题和内容

|

||||

markdown_content = f"# {title}\n\n{content}"

|

||||

|

||||

return markdown_content

|

||||

|

||||

except Exception as e:

|

||||

print(f"解析出错: {e}")

|

||||

return ""

|

||||

|

||||

|

||||

def save_markdown(content, output_file):

|

||||

"""

|

||||

保存Markdown内容到文件

|

||||

|

||||

Args:

|

||||

content: Markdown内容

|

||||

output_file: 输出文件路径

|

||||

"""

|

||||

try:

|

||||

with open(output_file, 'w', encoding='utf-8') as f:

|

||||

f.write(content)

|

||||

print(f"Markdown文件已保存: {output_file}")

|

||||

except Exception as e:

|

||||

print(f"保存文件出错: {e}")

|

||||

|

||||

|

||||

def main():

|

||||

"""

|

||||

主函数

|

||||

"""

|

||||

if len(sys.argv) != 2:

|

||||

print("使用方法: python parse_blog.py <html_file_path>")

|

||||

sys.exit(1)

|

||||

|

||||

html_file = sys.argv[1]

|

||||

|

||||

if not os.path.exists(html_file):

|

||||

print(f"文件不存在: {html_file}")

|

||||

sys.exit(1)

|

||||

|

||||

# 生成输出文件路径

|

||||

base_name = os.path.splitext(html_file)[0]

|

||||

output_file = f"{base_name}.md"

|

||||

|

||||

# 解析HTML并转换为Markdown

|

||||

print(f"正在解析: {html_file}")

|

||||

markdown_content = parse_zhihu_blog(html_file)

|

||||

|

||||

if markdown_content:

|

||||

# 保存为Markdown文件

|

||||

save_markdown(markdown_content, output_file)

|

||||

else:

|

||||

print("解析失败,无法生成Markdown文件")

|

||||

|

||||

|

||||

if __name__ == "__main__":

|

||||

main()

|

||||

3

tools/blog/requirements.txt

Normal file

3

tools/blog/requirements.txt

Normal file

@@ -0,0 +1,3 @@

|

||||

beautifulsoup4

|

||||

lxml

|

||||

markdownify

|

||||

15

tools/blog/test_output.md

Normal file

15

tools/blog/test_output.md

Normal file

@@ -0,0 +1,15 @@

|

||||

# SIGGRAPH 2025papers on the web

|

||||

|

||||

Page maintained byKe-Sen Huang.

|

||||

If you have additions or changes, send ane-mail.

|

||||

Information here is provided with the permission of the ACM

|

||||

Note that when possible I link to the page containing the link to the actual PDF or PS of the preprint.

|

||||

I prefer this as it gives some context to the paper and avoids possible copyright problems with direct linking.

|

||||

Thus you may need to search on the page to find the actual document.

|

||||

ACM Digital Library:ACM Transactions on Graphics (TOG) Volume 44, Issue 4 (July 2025) Proceedings of ACM SIGGRAPH 2025

|

||||

SIG/TOG:Journal Paper for presentation at SIGGRAPH 2025

|

||||

SIG:Conference Paper for presentation at SIGGRAPH 2025

|

||||

TOG:Selected ACM TOG Paper for presentation at SIGGRAPH 2025

|

||||

ACM Digital Library (DOI)Link for the paperPaper AbstractAuthor PreprintPaper Video

|

||||

Paper PresentationPaper ImagesPaper DataDemo Program or Source CodeRelated Links

|

||||

Changelog

|

||||

35

tools/blog/test_parse.py

Normal file

35

tools/blog/test_parse.py

Normal file

@@ -0,0 +1,35 @@

|

||||

#!/usr/bin/env python3

|

||||

# -*- coding: utf-8 -*-

|

||||

"""

|

||||

测试解析功能的脚本

|

||||

"""

|

||||

|

||||

from parse_blog import parse_zhihu_blog, save_markdown

|

||||

|

||||

|

||||

def test_parse():

|

||||

"""

|

||||

测试解析功能

|

||||

"""

|

||||

# 直接指定HTML文件路径

|

||||

html_file = "SIGGRAPH 2025 Papers.html"

|

||||

output_file = "test_output.md"

|

||||

|

||||

print(f"测试解析: {html_file}")

|

||||

|

||||

# 解析HTML

|

||||

markdown_content = parse_zhihu_blog(html_file)

|

||||

|

||||

if markdown_content:

|

||||

print(f"解析成功,内容长度: {len(markdown_content)}")

|

||||

print("\n前500个字符预览:")

|

||||

print(markdown_content[:500] + "...")

|

||||

|

||||

# 保存到文件

|

||||

save_markdown(markdown_content, output_file)

|

||||

else:

|

||||

print("解析失败")

|

||||

|

||||

|

||||

if __name__ == "__main__":

|

||||

test_parse()

|

||||

6

tools/clipboard/requirements.txt

Normal file

6

tools/clipboard/requirements.txt

Normal file

@@ -0,0 +1,6 @@

|

||||

pyperclip

|

||||

Pillow

|

||||

pywin32

|

||||

beautifulsoup4

|

||||

markdownify

|

||||

requests

|

||||

250

tools/clipboard/save_from_clipboard.py

Normal file

250

tools/clipboard/save_from_clipboard.py

Normal file

@@ -0,0 +1,250 @@

|

||||

import os

|

||||

import datetime

|

||||

import re

|

||||

import base64

|

||||

import shutil

|

||||

import requests

|

||||

import random

|

||||

from urllib.parse import unquote, urlparse

|

||||

from io import BytesIO

|

||||

|

||||

# Third-party libraries

|

||||

import pyperclip

|

||||

from PIL import ImageGrab, Image

|

||||

import win32clipboard

|

||||

from bs4 import BeautifulSoup

|

||||

from markdownify import markdownify as md

|

||||

|

||||

# Configuration

|

||||

PROJECT_ROOT = os.path.dirname(os.path.dirname(os.path.dirname(os.path.abspath(__file__))))

|

||||

MARKDOWN_DIR = os.path.join(PROJECT_ROOT, 'notebook', 'markdowns')

|

||||

IMAGES_DIR = os.path.join(PROJECT_ROOT, 'notebook', 'images')

|

||||

|

||||

def sanitize_filename(name):

|

||||

"""Sanitize string to be used as filename"""

|

||||

safe_name = "".join([c for c in name if c.isalnum() or c in (' ', '-', '_')]).strip()

|

||||

return safe_name[:100]

|

||||

|

||||

def get_html_from_clipboard():

|

||||

"""Extract HTML format from Windows Clipboard"""

|

||||

try:

|

||||

win32clipboard.OpenClipboard()

|

||||

|

||||

# Register/Get HTML Format ID

|

||||

html_format = win32clipboard.RegisterClipboardFormat("HTML Format")

|

||||

|

||||

if win32clipboard.IsClipboardFormatAvailable(html_format):

|

||||

raw_data = win32clipboard.GetClipboardData(html_format)

|

||||

win32clipboard.CloseClipboard()

|

||||

|

||||

# Raw data contains headers, we need to decode and parse them

|

||||

# Example Header:

|

||||

# Version:0.9

|

||||

# StartHTML:00000097

|

||||

# EndHTML:00000170

|

||||

# StartFragment:00000133

|

||||

# EndFragment:00000134

|

||||

|

||||

try:

|

||||

html_str = raw_data.decode('utf-8')

|

||||

except:

|

||||

html_str = raw_data.decode('cp1252', errors='ignore')

|

||||

|

||||

# Extract the actual HTML fragment using regex or string splitting

|

||||

start_html = re.search(r'StartHTML:(\d+)', html_str)

|

||||

end_html = re.search(r'EndHTML:(\d+)', html_str)

|

||||

|

||||

if start_html and end_html:

|

||||

start_idx = int(start_html.group(1))

|

||||

end_idx = int(end_html.group(1))

|

||||

return html_str[start_idx:end_idx]

|

||||

|

||||

return html_str # Fallback to full string if parsing fails

|

||||

|

||||

win32clipboard.CloseClipboard()

|

||||

return None

|

||||

except Exception as e:

|

||||

print(f"Error reading clipboard HTML: {e}")

|

||||

try:

|

||||

win32clipboard.CloseClipboard()

|

||||

except:

|

||||

pass

|

||||

return None

|

||||

|

||||

def process_html_images(html_content, timestamp):

|

||||

"""Find images in HTML, save them locally, and update src"""

|

||||

soup = BeautifulSoup(html_content, 'html.parser')

|

||||

|

||||

for img in soup.find_all('img'):

|

||||

src = img.get('src')

|

||||

if not src:

|

||||

continue

|

||||

|

||||

new_filename = None

|

||||

|

||||

# Case 1: Base64 Image

|

||||

if src.startswith('data:image'):

|

||||

try:

|

||||

# Extract header and data

|

||||

# data:image/png;base64,xxxx

|

||||

match = re.match(r'data:image/(\w+);base64,(.+)', src)

|

||||

if match:

|

||||

ext = match.group(1)

|

||||

if ext == 'jpeg': ext = 'jpg'

|

||||

data_str = match.group(2)

|

||||

|

||||

img_data = base64.b64decode(data_str)

|

||||

new_filename = f"paste_img_{timestamp}_{random.randint(1000,9999)}.{ext}"

|

||||

dest_path = os.path.join(IMAGES_DIR, new_filename)

|

||||

|

||||

with open(dest_path, 'wb') as f:

|

||||

f.write(img_data)

|

||||

print(f" - Saved Base64 image: {new_filename}")

|

||||

except Exception as e:

|

||||

print(f" - Failed to process base64 image: {e}")

|

||||

|

||||

# Case 2: Local File (file://)

|

||||

elif src.startswith('file://'):

|

||||

try:

|

||||

# Remove file:// prefix and decode URL encoded chars

|

||||

local_path = unquote(src[7:])

|

||||

# On Windows, it might be file:///C:/... -> /C:/... -> C:/...

|

||||

if local_path.startswith('/') and ':' in local_path:

|

||||

local_path = local_path[1:]

|

||||

|

||||

if os.path.exists(local_path):

|

||||

ext = os.path.splitext(local_path)[1]

|

||||

if not ext: ext = '.png'

|

||||

|

||||

new_filename = f"paste_img_{timestamp}_{random.randint(1000,9999)}{ext}"

|

||||

dest_path = os.path.join(IMAGES_DIR, new_filename)

|

||||

|

||||

shutil.copy2(local_path, dest_path)

|

||||

print(f" - Copied local image: {new_filename}")

|

||||

except Exception as e:

|

||||

print(f" - Failed to copy local image: {e}")

|

||||

|

||||

# Case 3: Remote URL (http/https)

|

||||

# Optional: We could download it, but for now let's keep it as is

|

||||

# or download if it's a direct image link.

|

||||

# Let's try to download to make it truly local/offline

|

||||

elif src.startswith('http'):

|

||||

try:

|

||||

# Basic check if it's an image

|

||||

# We skip downloading if user wants to keep remote links, but usually local is better for notes

|

||||

# Let's try downloading

|

||||

response = requests.get(src, timeout=5)

|

||||

if response.status_code == 200 and 'image' in response.headers.get('content-type', ''):

|

||||

ext = '.jpg' # default

|

||||

if 'png' in response.headers['content-type']: ext = '.png'

|

||||

elif 'gif' in response.headers['content-type']: ext = '.gif'

|

||||

|

||||

new_filename = f"paste_img_{timestamp}_{random.randint(1000,9999)}{ext}"

|

||||

dest_path = os.path.join(IMAGES_DIR, new_filename)

|

||||

|

||||

with open(dest_path, 'wb') as f:

|

||||

f.write(response.content)

|

||||

print(f" - Downloaded remote image: {new_filename}")

|

||||

except Exception as e:

|

||||

print(f" - Failed to download remote image: {e}")

|

||||

|

||||

# Update src in HTML if we saved a file

|

||||

if new_filename:

|

||||

# We use bare filename as requested

|

||||

img['src'] = new_filename

|

||||

|

||||

return str(soup)

|

||||

|

||||

def extract_title_from_markdown(md_text):

|

||||

"""Try to find the first H1 header to use as title"""

|

||||

lines = md_text.strip().split('\n')

|

||||

for line in lines[:10]:

|

||||

if line.strip().startswith('# '):

|

||||

return sanitize_filename(line.strip()[2:])

|

||||

return None

|

||||

|

||||

def save_clipboard_content():

|

||||

# Ensure directories exist

|

||||

os.makedirs(MARKDOWN_DIR, exist_ok=True)

|

||||

os.makedirs(IMAGES_DIR, exist_ok=True)

|

||||

|

||||

timestamp = datetime.datetime.now().strftime('%Y%m%d_%H%M%S')

|

||||

|

||||

# Priority 1: Check for HTML (Rich Text)

|

||||

# This covers most "Copy from Note App" scenarios

|

||||

html_content = get_html_from_clipboard()

|

||||

|

||||

if html_content:

|

||||

print("Detected HTML/Rich Text in clipboard...")

|

||||

|

||||

# 1. Process Images in HTML (Save to disk)

|

||||

processed_html = process_html_images(html_content, timestamp)

|

||||

|

||||

# 2. Convert to Markdown

|

||||

# heading_style='atx' ensures # Header style instead of underlines

|

||||

md_text = md(processed_html, heading_style='atx')

|

||||

|

||||

# 3. Clean up extra newlines often introduced by conversion

|

||||

md_text = re.sub(r'\n{3,}', '\n\n', md_text).strip()

|

||||

|

||||

# 4. Determine Filename

|

||||

title = extract_title_from_markdown(md_text)

|

||||

markdown_filename = f"{title}.md" if title else f"Note_{timestamp}.md"

|

||||

|

||||

# 5. Save

|

||||

markdown_path = os.path.join(MARKDOWN_DIR, markdown_filename)

|

||||

# Avoid collision

|

||||

if os.path.exists(markdown_path):

|

||||

markdown_filename = f"{title}_{timestamp}.md" if title else f"Note_{timestamp}_1.md"

|

||||

markdown_path = os.path.join(MARKDOWN_DIR, markdown_filename)

|

||||

|

||||

with open(markdown_path, 'w', encoding='utf-8') as f:

|

||||

f.write(md_text)

|

||||

|

||||

print(f"Saved Rich Text Note to: {markdown_path}")

|

||||

return

|

||||

|

||||

# Priority 2: Check for Bitmap Image (Direct Screenshot Copy)

|

||||

try:

|

||||

image = ImageGrab.grabclipboard()

|

||||

if image and not isinstance(image, list):

|

||||

print("Detected BITMAP image in clipboard...")

|

||||

image_filename = f"clip_image_{timestamp}.png"

|

||||

image_path = os.path.join(IMAGES_DIR, image_filename)

|

||||

image.save(image_path, 'PNG')

|

||||

|

||||

markdown_filename = f"Image_{timestamp}.md"

|

||||

markdown_path = os.path.join(MARKDOWN_DIR, markdown_filename)

|

||||

|

||||

# Use bare filename as requested

|

||||

content = f"# Clipboard Image {timestamp}\n\n"

|

||||

|

||||

with open(markdown_path, 'w', encoding='utf-8') as f:

|

||||

f.write(content)

|

||||

|

||||

print(f"Saved image to: {image_path}")

|

||||

print(f"Saved markdown to: {markdown_path}")

|

||||

return

|

||||

except Exception as e:

|

||||

print(f"Error checking bitmap: {e}")

|

||||

|

||||

# Priority 3: Fallback to Plain Text

|

||||

text = pyperclip.paste()

|

||||

if text:

|

||||

print("Detected PLAIN TEXT in clipboard...")

|

||||

title = extract_title_from_markdown(text)

|

||||

markdown_filename = f"{title}.md" if title else f"Note_{timestamp}.md"

|

||||

markdown_path = os.path.join(MARKDOWN_DIR, markdown_filename)

|

||||

|

||||

if os.path.exists(markdown_path):

|

||||

markdown_filename = f"{title}_{timestamp}.md" if title else f"Note_{timestamp}_1.md"

|

||||

markdown_path = os.path.join(MARKDOWN_DIR, markdown_filename)

|

||||

|

||||

with open(markdown_path, 'w', encoding='utf-8') as f:

|

||||

f.write(text)

|

||||

print(f"Saved Text Note to: {markdown_path}")

|

||||

else:

|

||||

print("Clipboard is empty.")

|

||||

|

||||

if __name__ == "__main__":

|

||||

save_clipboard_content()

|

||||

158

tools/doubao/main.py

Normal file

158

tools/doubao/main.py

Normal file

@@ -0,0 +1,158 @@

|

||||

import os

|

||||

import sys

|

||||

import argparse

|

||||

import time

|

||||

from openai import OpenAI

|

||||

|

||||

# 任务定义

|

||||

TASKS = {

|

||||

"fix_markdown": {

|

||||

"system": "你是一个 Markdown 格式专家。请修复以下 Markdown 文档片段的格式问题。不要修改文档的原始内容,只调整格式(如标题、列表、代码块等的规范化)。直接输出修复后的 Markdown 内容,不要包含任何解释或 ```markdown 标记。注意:这是长文档的一部分,请保持上下文连贯。",

|

||||

}

|

||||

}

|

||||

|

||||

# 最大块大小(字符数)

|

||||

MAX_CHUNK_SIZE = 3000

|

||||

|

||||

def split_markdown(text, max_length=MAX_CHUNK_SIZE):

|

||||

"""

|

||||

将 Markdown 文本分割成较小的块,尽量保持段落和代码块完整。

|

||||

"""

|

||||

lines = text.split('\n')

|

||||

chunks = []

|

||||

current_chunk = []

|

||||

current_length = 0

|

||||

in_code_block = False

|

||||

|

||||

for line in lines:

|

||||

# 检测代码块状态

|

||||

if line.strip().startswith('```'):

|

||||

in_code_block = not in_code_block

|

||||

|

||||

line_len = len(line) + 1 # +1 for newline

|

||||

|

||||

# 决定是否需要切分:

|

||||

# 1. 当前长度超过最大限制

|

||||

# 2. 且不在代码块内 (in_code_block == False)

|

||||

if current_length + line_len > max_length and not in_code_block:

|

||||

# 如果当前块不为空,则保存当前块

|

||||

if current_chunk:

|

||||

chunks.append('\n'.join(current_chunk))

|

||||

current_chunk = []

|

||||

current_length = 0

|

||||

|

||||

# 如果单行本身就超过了最大长度(极少见情况),也只能强行放入

|

||||

current_chunk.append(line)

|

||||

current_length += line_len

|

||||

else:

|

||||

current_chunk.append(line)

|

||||

current_length += line_len

|

||||

|

||||

if current_chunk:

|

||||

chunks.append('\n'.join(current_chunk))

|

||||

|

||||

return chunks

|

||||

|

||||

def process_chunk(client, content, task_config, model="doubao-seed-1-8-251228"):

|

||||

"""

|

||||

处理单个文本块

|

||||

"""

|

||||

try:

|

||||

completion = client.chat.completions.create(

|

||||

model=model,

|

||||

messages=[

|

||||

{"role": "system", "content": task_config["system"]},

|

||||

{"role": "user", "content": content},

|

||||

],

|

||||

max_tokens=4096, # 保持较大的输出 token 限制

|

||||

)

|

||||

return completion.choices[0].message.content

|

||||

except Exception as e:

|

||||

# 如果出错,打印错误到 stderr 但不中断整个流程(或者选择中断)

|

||||

# 这里选择抛出异常以便外层捕获

|

||||

raise e

|

||||

|

||||

def main():

|

||||

parser = argparse.ArgumentParser(description="Doubao AI Task Executor")

|

||||

parser.add_argument("--task", required=True, help="Task name", choices=TASKS.keys())

|

||||

args = parser.parse_args()

|

||||

|

||||

# 优先从环境变量读取,如果没有则使用硬编码的 Key (仅供演示,实际应走环境变量)

|

||||

api_key = os.getenv('ARK_API_KEY') or "a5ab502d-c9a9-49f3-a80b-9c80c6b5378b"

|

||||

|

||||

if not api_key:

|

||||

print("Error: ARK_API_KEY environment variable is not set.", file=sys.stderr)

|

||||

sys.exit(1)

|

||||

|

||||

client = OpenAI(

|

||||

base_url="https://ark.cn-beijing.volces.com/api/v3",

|

||||

api_key=api_key,

|

||||

)

|

||||

|

||||

# Windows UTF-8 处理

|

||||

if sys.platform == 'win32':

|

||||

import io

|

||||

sys.stdin = io.TextIOWrapper(sys.stdin.buffer, encoding='utf-8', errors='ignore')

|

||||

sys.stdout = io.TextIOWrapper(sys.stdout.buffer, encoding='utf-8', errors='ignore')

|

||||

|

||||

# 读取全部内容

|

||||

content = sys.stdin.read()

|

||||

|

||||

# 清洗非法字符

|

||||

content = content.encode('utf-8', 'ignore').decode('utf-8')

|

||||

|

||||

if not content:

|

||||

print("Error: No input content provided via stdin.", file=sys.stderr)

|

||||

sys.exit(1)

|

||||

|

||||

task_config = TASKS[args.task]

|

||||

|

||||

# 1. 分割文本

|

||||

chunks = split_markdown(content)

|

||||

|

||||

# 2. 依次处理

|

||||

results = []

|

||||

total_chunks = len(chunks)

|

||||

|

||||

# 打印进度信息到 stderr (前端看不到,但方便调试)

|

||||

print(f"Processing {total_chunks} chunks...", file=sys.stderr)

|

||||

|

||||

for i, chunk in enumerate(chunks):

|

||||

try:

|

||||

# 简单的重试机制

|

||||

retry_count = 0

|

||||

max_retries = 3

|

||||

result = None

|

||||

|

||||

while retry_count < max_retries:

|

||||

try:

|

||||

result = process_chunk(client, chunk, task_config)

|

||||

break

|

||||

except Exception as e:

|

||||

retry_count += 1

|

||||

print(f"Chunk {i+1}/{total_chunks} failed (attempt {retry_count}): {e}", file=sys.stderr)

|

||||

time.sleep(2) # 等待后重试

|

||||

|

||||

if result is None:

|

||||

print(f"Error: Failed to process chunk {i+1} after {max_retries} attempts.", file=sys.stderr)

|

||||

# 失败时保留原始内容,避免数据丢失

|

||||

results.append(chunk)

|

||||

else:

|

||||

results.append(result)

|

||||

|

||||

# 避免触发速率限制

|

||||

if i < total_chunks - 1:

|

||||

time.sleep(0.5)

|

||||

|

||||

except Exception as e:

|

||||

print(f"Critical error on chunk {i+1}: {e}", file=sys.stderr)

|

||||

results.append(chunk)

|

||||

|

||||

# 3. 合并输出

|

||||

final_output = '\n'.join(results)

|

||||

|

||||

# 4. 打印最终结果

|

||||

print(final_output)

|

||||

|

||||

if __name__ == "__main__":

|

||||

main()

|

||||

1

tools/doubao/requirements.txt

Normal file

1

tools/doubao/requirements.txt

Normal file

@@ -0,0 +1 @@

|

||||

openai

|

||||

0

tools/mineru/api.md

Normal file

0

tools/mineru/api.md

Normal file

21

tools/mineru/config.py

Normal file

21

tools/mineru/config.py

Normal file

@@ -0,0 +1,21 @@

|

||||

import os

|

||||

from dotenv import load_dotenv

|

||||

|

||||

# 加载环境变量

|

||||

load_dotenv()

|

||||

|

||||

# Mineru API 配置

|

||||

MINERU_API_URL = "https://mineru.net/api/v4"

|

||||

MINERU_TOKEN = "eyJ0eXBlIjoiSldUIiwiYWxnIjoiSFM1MTIifQ.eyJqdGkiOiI0NDIwMDY1NyIsInJvbCI6IlJPTEVfUkVHSVNURVIiLCJpc3MiOiJPcGVuWExhYiIsImlhdCI6MTc3MDIyMDU4OSwiY2xpZW50SWQiOiJsa3pkeDU3bnZ5MjJqa3BxOXgydyIsInBob25lIjoiIiwib3BlbklkIjpudWxsLCJ1dWlkIjoiMTE4MDA1YjctYWRiYy00MmY0LTkyZTYtZWM4M2Q1ZWRiOTQzIiwiZW1haWwiOiIiLCJleHAiOjE3NzE0MzAxODl9.cVCGxc97GNCdQPYmaP9hbYptfenAK6o8xJ0CZtEOxOhOEgVhV519P7X61FmdLgSs4QRZYs0ZM_4VRwQgVFnJ0w"

|

||||

|

||||

# 阿里云 OSS 配置

|

||||

OSS_ACCESS_KEY_ID = "LTAI5tB7sQADpKZnXY7s6Xz8"

|

||||

OSS_ACCESS_KEY_SECRET = "Fgab9klwKoH1GACP97WIb7s6BSvNAm"

|

||||

OSS_BUCKET_NAME = "bucket-xcnote" # 测试用的 OSS 桶名称

|

||||

OSS_ENDPOINT = "https://oss-cn-beijing.aliyuncs.com"

|

||||

|

||||

# 本地文件配置

|

||||

TEMP_DIR = "./temp"

|

||||

|

||||

# 确保临时目录存在

|

||||

os.makedirs(TEMP_DIR, exist_ok=True)

|

||||

3

tools/mineru/key.md

Normal file

3

tools/mineru/key.md

Normal file

@@ -0,0 +1,3 @@

|

||||

xuanchi

|

||||

|

||||

eyJ0eXBlIjoiSldUIiwiYWxnIjoiSFM1MTIifQ.eyJqdGkiOiI0NDIwMDY1NyIsInJvbCI6IlJPTEVfUkVHSVNURVIiLCJpc3MiOiJPcGVuWExhYiIsImlhdCI6MTc3MDIyMDU4OSwiY2xpZW50SWQiOiJsa3pkeDU3bnZ5MjJqa3BxOXgydyIsInBob25lIjoiIiwib3BlbklkIjpudWxsLCJ1dWlkIjoiMTE4MDA1YjctYWRiYy00MmY0LTkyZTYtZWM4M2Q1ZWRiOTQzIiwiZW1haWwiOiIiLCJleHAiOjE3NzE0MzAxODl9.cVCGxc97GNCdQPYmaP9hbYptfenAK6o8xJ0CZtEOxOhOEgVhV519P7X61FmdLgSs4QRZYs0ZM_4VRwQgVFnJ0w

|

||||

326

tools/mineru/mineru_parser.py

Normal file

326

tools/mineru/mineru_parser.py

Normal file

@@ -0,0 +1,326 @@

|

||||

#!/usr/bin/env python

|

||||

# coding=utf-8

|

||||

|

||||

import os

|

||||

import time

|

||||

import requests

|

||||

import zipfile

|

||||

import json

|

||||

from config import (

|

||||

MINERU_API_URL,

|

||||

MINERU_TOKEN,

|

||||

OSS_ACCESS_KEY_ID,

|

||||

OSS_ACCESS_KEY_SECRET,

|

||||

OSS_BUCKET_NAME,

|

||||

OSS_ENDPOINT,

|

||||

TEMP_DIR,

|

||||

)

|

||||

import sys

|

||||

|

||||

sys.path.append(os.path.dirname(os.path.dirname(os.path.abspath(__file__))))

|

||||

from shared.oss_upload import upload_file_to_oss

|

||||

|

||||

|

||||

def create_parse_task(url, model_version="vlm"):

|

||||

"""

|

||||

创建解析任务

|

||||

:param url: 文件URL

|

||||

:param model_version: 模型版本,默认为vlm

|

||||

:return: 任务ID

|

||||

"""

|

||||

print(f"开始创建解析任务: {url}")

|

||||

|

||||

api_url = f"{MINERU_API_URL}/extract/task"

|

||||

headers = {

|

||||

"Content-Type": "application/json",

|

||||

"Authorization": f"Bearer {MINERU_TOKEN}",

|

||||

}

|

||||

data = {"url": url, "model_version": model_version}

|

||||

|

||||

try:

|

||||

response = requests.post(api_url, headers=headers, json=data)

|

||||

response.raise_for_status()

|

||||

result = response.json()

|

||||

|

||||

if result.get("code") == 0:

|

||||

task_id = result.get("data", {}).get("task_id")

|

||||

print(f"任务创建成功: {task_id}")

|

||||

return task_id

|

||||

else:

|

||||

print(f"任务创建失败: {result.get('msg')}")

|

||||

return None

|

||||

|

||||

except Exception as e:

|

||||

print(f"创建任务失败: {e}")

|

||||

import traceback

|

||||

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

|

||||

def get_task_status(task_id):

|

||||

"""

|

||||

获取任务状态

|

||||

:param task_id: 任务ID

|

||||

:return: 任务状态

|

||||

"""

|

||||

print(f"查询任务状态: {task_id}")

|

||||

|

||||

api_url = f"{MINERU_API_URL}/extract/task/{task_id}"

|

||||

headers = {

|

||||

"Content-Type": "application/json",

|

||||

"Authorization": f"Bearer {MINERU_TOKEN}",

|

||||

}

|

||||

|

||||

try:

|

||||

response = requests.get(api_url, headers=headers)

|

||||

response.raise_for_status()

|

||||

result = response.json()

|

||||

|

||||

if result.get("code") == 0:

|

||||

status = result.get("data", {})

|

||||

print(f"任务状态: {status.get('state')}")

|

||||

return status

|

||||

else:

|

||||

print(f"查询状态失败: {result.get('msg')}")

|

||||

return None

|

||||

|

||||

except Exception as e:

|

||||

print(f"查询状态失败: {e}")

|

||||

import traceback

|

||||

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

|

||||

def poll_task_status(task_id, max_retries=60, interval=5):

|

||||

"""

|

||||

轮询任务状态

|

||||

:param task_id: 任务ID

|

||||

:param max_retries: 最大重试次数

|

||||

:param interval: 轮询间隔(秒)

|

||||

:return: 任务完成状态

|

||||

"""

|

||||

print(f"开始轮询任务状态: {task_id}")

|

||||

|

||||

for i in range(max_retries):

|

||||

status = get_task_status(task_id)

|

||||

if status:

|

||||

state = status.get("state")

|

||||

if state == "done":

|

||||

print("任务完成!")

|

||||

return status

|

||||

elif state == "failed":

|

||||

print(f"任务失败: {status.get('err_msg')}")

|

||||

return None

|

||||

elif state in ["pending", "running", "converting"]:

|

||||

print(f"任务正在进行中 ({state}),{interval}秒后重试...")

|

||||

time.sleep(interval)

|

||||

else:

|

||||

print(f"未知状态: {state}")

|

||||

time.sleep(interval)

|

||||

else:

|

||||

print(f"获取状态失败,{interval}秒后重试...")

|

||||

time.sleep(interval)

|

||||

|

||||

print("轮询超时,任务可能仍在处理中")

|

||||

return None

|

||||

|

||||

|

||||

def download_and_extract_result(zip_url, output_dir):

|

||||

"""

|

||||

下载并提取解析结果

|

||||

:param zip_url: 结果压缩包URL

|

||||

:param output_dir: 输出目录

|

||||

:return: 提取的文件列表

|

||||

"""

|

||||

print(f"开始下载解析结果: {zip_url}")

|

||||

|

||||

# 确保输出目录存在

|

||||

os.makedirs(output_dir, exist_ok=True)

|

||||

|

||||

# 下载压缩包

|

||||

zip_path = os.path.join(output_dir, "result.zip")

|

||||

try:

|

||||

response = requests.get(zip_url, stream=True)

|

||||

response.raise_for_status()

|

||||

|

||||

with open(zip_path, "wb") as f:

|

||||

for chunk in response.iter_content(chunk_size=8192):

|

||||

f.write(chunk)

|

||||

print(f"压缩包下载成功: {zip_path}")

|

||||

|

||||

# 提取压缩包

|

||||

extracted_files = []

|

||||

with zipfile.ZipFile(zip_path, "r") as zip_ref:

|

||||

zip_ref.extractall(output_dir)

|

||||

print(f"压缩包提取成功: {output_dir}")

|

||||

extracted_files = zip_ref.namelist()

|

||||

|

||||

# 删除压缩包

|

||||

os.remove(zip_path)

|

||||

print(f"删除临时压缩包: {zip_path}")

|

||||

|

||||

return extracted_files

|

||||

|

||||

except Exception as e:

|

||||

print(f"下载或提取失败: {e}")

|

||||

import traceback

|

||||

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

|

||||

def get_markdown_result(extracted_files, output_dir):

|

||||

"""

|

||||

获取Markdown格式的解析结果

|

||||

:param extracted_files: 提取的文件列表

|

||||

:param output_dir: 输出目录

|

||||

:return: Markdown内容

|

||||

"""

|

||||

print("查找Markdown格式的解析结果")

|

||||

|

||||

for file_name in extracted_files:

|

||||

if file_name.endswith(".md"):

|

||||

md_path = os.path.join(output_dir, file_name)

|

||||

print(f"找到Markdown文件: {md_path}")

|

||||

|

||||

try:

|

||||

with open(md_path, "r", encoding="utf-8") as f:

|

||||

md_content = f.read()

|

||||

print(f"Markdown文件读取成功,长度: {len(md_content)} 字符")

|

||||

return md_content

|

||||

except Exception as e:

|

||||

print(f"读取Markdown文件失败: {e}")

|

||||

import traceback

|

||||

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

print("未找到Markdown格式的解析结果")

|

||||

return None

|

||||

|

||||

|

||||

def parse_local_file(file_path, model_version="vlm"):

|

||||

"""

|

||||

解析本地文件

|

||||

:param file_path: 本地文件路径

|

||||

:param model_version: 模型版本,默认为vlm

|

||||

:return: Markdown内容

|

||||

"""

|

||||

print(f"开始解析本地文件: {file_path}")

|

||||

|

||||

# 检查文件是否存在

|

||||

if not os.path.exists(file_path):

|

||||

print(f"文件不存在: {file_path}")

|

||||

return None

|

||||

|

||||

# 检查文件大小

|

||||

file_size = os.path.getsize(file_path)

|

||||

if file_size > 200 * 1024 * 1024: # 200MB

|

||||

print(f"文件大小超出限制: {file_size} bytes (最大200MB)")

|

||||

return None

|

||||

|

||||

# 生成对象名称

|

||||

timestamp = int(time.time())

|

||||

file_name = os.path.basename(file_path)

|

||||

object_name = f"mineru/{timestamp}_{file_name}"

|

||||

|

||||

# 上传文件到OSS

|

||||

oss_url = upload_file_to_oss(

|

||||

file_path,

|

||||

OSS_BUCKET_NAME,

|

||||

object_name,

|

||||

OSS_ACCESS_KEY_ID,

|

||||

OSS_ACCESS_KEY_SECRET,

|

||||

OSS_ENDPOINT,

|

||||

)

|

||||

|

||||

if not oss_url:

|

||||

print("文件上传失败,无法继续解析")

|

||||

return None

|

||||

|

||||

# 创建解析任务

|

||||

task_id = create_parse_task(oss_url, model_version)

|

||||

|

||||

if not task_id:

|

||||

print("任务创建失败,无法继续解析")

|

||||

return None

|

||||

|

||||

# 轮询任务状态

|

||||

task_status = poll_task_status(task_id)

|

||||

|

||||

if not task_status:

|

||||

print("任务执行失败,无法获取解析结果")

|

||||

return None

|

||||

|

||||

# 获取结果URL

|

||||

zip_url = task_status.get("full_zip_url")

|

||||

if not zip_url:

|

||||

print("未找到解析结果URL")

|

||||

return None

|

||||

|

||||

# 生成输出目录

|

||||

output_dir = os.path.join(TEMP_DIR, task_id)

|

||||

|

||||

# 下载并提取结果

|

||||

extracted_files = download_and_extract_result(zip_url, output_dir)

|

||||

|

||||

if not extracted_files:

|

||||

print("下载或提取结果失败")

|

||||

return None

|

||||

|

||||

# 获取Markdown结果

|

||||

md_content = get_markdown_result(extracted_files, output_dir)

|

||||

|

||||

if not md_content:

|

||||

print("未找到Markdown格式的解析结果")

|

||||

return None

|

||||

|

||||

print("文件解析完成,成功获取Markdown格式的结果")

|

||||

return {"content": md_content, "output_dir": output_dir}

|

||||

|

||||

|

||||

def main():

|

||||

"""

|

||||

主函数

|

||||

"""

|

||||

import sys

|

||||

|

||||

if len(sys.argv) != 2:

|

||||

print("使用方法: python mineru_parser.py <本地文件路径>")

|

||||

print("示例: python mineru_parser.py ./example.pdf")

|

||||

sys.exit(1)

|

||||

|

||||

file_path = sys.argv[1]

|

||||

|

||||

# 解析文件

|

||||

result = parse_local_file(file_path)

|

||||

|

||||

if result:

|

||||

md_content = result["content"]

|

||||

output_dir = result["output_dir"]

|

||||

|

||||

# 保存Markdown结果

|

||||

output_file = os.path.join(TEMP_DIR, f"{os.path.basename(file_path)}.md")

|

||||

with open(output_file, "w", encoding="utf-8") as f:

|

||||

f.write(md_content)

|

||||

|

||||

# Print JSON result for caller to parse

|

||||

print(

|

||||

"JSON_RESULT:"

|

||||

+ json.dumps(

|

||||

{

|

||||

"status": "success",

|

||||

"markdown_file": os.path.abspath(output_file),

|

||||

"output_dir": os.path.abspath(output_dir),

|

||||

}

|

||||

)

|

||||

)

|

||||

else:

|

||||

print("文件解析失败")

|

||||

sys.exit(1)

|

||||

|

||||

|

||||

if __name__ == "__main__":

|

||||

main()

|

||||

3

tools/mineru/requirements.txt

Normal file

3

tools/mineru/requirements.txt

Normal file

@@ -0,0 +1,3 @@

|

||||

requests

|

||||

oss2

|

||||

python-dotenv

|

||||

105

tools/mineru/test_api.py

Normal file

105

tools/mineru/test_api.py

Normal file

@@ -0,0 +1,105 @@

|

||||

#!/usr/bin/env python

|

||||

#coding=utf-8

|

||||

|

||||

import requests

|

||||

from config import MINERU_API_URL, MINERU_TOKEN

|

||||

|

||||

def test_create_task():

|

||||

"""

|

||||

测试创建解析任务

|

||||

"""

|

||||

print("测试创建解析任务...")

|

||||

|

||||

api_url = f"{MINERU_API_URL}/extract/task"

|

||||

headers = {

|

||||

"Content-Type": "application/json",

|

||||

"Authorization": f"Bearer {MINERU_TOKEN}"

|

||||

}

|

||||

# 使用官方示例 URL

|

||||

data = {

|

||||

"url": "https://cdn-mineru.openxlab.org.cn/demo/example.pdf",

|

||||

"model_version": "vlm"

|

||||

}

|

||||

|

||||

try:

|

||||

response = requests.post(api_url, headers=headers, json=data)

|

||||

print(f"状态码: {response.status_code}")

|

||||

print(f"响应内容: {response.json()}")

|

||||

|

||||

if response.status_code == 200:

|

||||

result = response.json()

|

||||

if result.get("code") == 0:

|

||||

task_id = result.get("data", {}).get("task_id")

|

||||

print(f"任务创建成功,任务ID: {task_id}")

|

||||

return task_id

|

||||

else:

|

||||

print(f"任务创建失败: {result.get('msg')}")

|

||||

return None

|

||||

else:

|

||||

print(f"请求失败,状态码: {response.status_code}")

|

||||

return None

|

||||

|

||||

except Exception as e:

|

||||

print(f"测试失败: {e}")

|

||||

import traceback

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

def test_get_task_status(task_id):

|

||||

"""

|

||||

测试获取任务状态

|

||||

"""

|

||||

if not task_id:

|

||||

print("任务ID为空,跳过测试")

|

||||

return None

|

||||

|

||||

print(f"测试获取任务状态...")

|

||||

|

||||

api_url = f"{MINERU_API_URL}/extract/task/{task_id}"

|

||||

headers = {

|

||||

"Content-Type": "application/json",

|

||||

"Authorization": f"Bearer {MINERU_TOKEN}"

|

||||

}

|

||||

|

||||

try:

|

||||

response = requests.get(api_url, headers=headers)

|

||||

print(f"状态码: {response.status_code}")

|

||||

print(f"响应内容: {response.json()}")

|

||||

|

||||

if response.status_code == 200:

|

||||

result = response.json()

|

||||

if result.get("code") == 0:

|

||||

status = result.get("data", {})

|

||||

print(f"任务状态获取成功,状态: {status.get('state')}")

|

||||

return status

|

||||

else:

|

||||

print(f"获取状态失败: {result.get('msg')}")

|

||||

return None

|

||||

else:

|

||||

print(f"请求失败,状态码: {response.status_code}")

|

||||

return None

|

||||

|

||||

except Exception as e:

|

||||

print(f"测试失败: {e}")

|

||||

import traceback

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

def main():

|

||||

"""

|

||||

主函数

|

||||

"""

|

||||

print("开始测试 Mineru API...")

|

||||

|

||||

# 测试创建任务

|

||||

task_id = test_create_task()

|

||||

|

||||

# 测试获取任务状态

|

||||

if task_id:

|

||||

test_get_task_status(task_id)

|

||||

|

||||

print("API 测试完成")

|

||||

|

||||

|

||||

if __name__ == "__main__":

|

||||

main()

|

||||

BIN

tools/shared/__pycache__/oss_upload.cpython-313.pyc

Normal file

BIN

tools/shared/__pycache__/oss_upload.cpython-313.pyc

Normal file

Binary file not shown.

84

tools/shared/oss_upload.py

Normal file

84

tools/shared/oss_upload.py

Normal file

@@ -0,0 +1,84 @@

|

||||

#!/usr/bin/env python

|

||||

#coding=utf-8

|

||||

|

||||

import os

|

||||

import oss2

|

||||

from oss2 import Auth

|

||||

|

||||

def upload_file_to_oss(local_file_path, bucket_name, object_name, access_key_id, access_key_secret, endpoint='https://oss-cn-beijing.aliyuncs.com'):

|

||||

"""

|

||||

上传文件到OSS

|

||||

:param local_file_path: 本地文件路径

|

||||

:param bucket_name: OSS桶名称

|

||||

:param object_name: OSS对象名称

|

||||

:param access_key_id: 阿里云AccessKey ID

|

||||

:param access_key_secret: 阿里云AccessKey Secret

|

||||

:param endpoint: OSS端点,默认为北京区域

|

||||

:return: OSS文件URL

|

||||

"""

|

||||

print(f"开始上传文件到OSS: {local_file_path}")

|

||||

|

||||

try:

|

||||

# 创建OSS客户端

|

||||

auth = Auth(access_key_id, access_key_secret)

|

||||

bucket = oss2.Bucket(auth, endpoint, bucket_name)

|

||||

|

||||

# 上传文件

|

||||

bucket.put_object_from_file(object_name, local_file_path)

|

||||

print(f"文件上传成功: {object_name}")

|

||||

|

||||

# 生成可访问的URL

|

||||

# 注意:这里生成的是临时URL,有效期为3600秒

|

||||

# 如果需要永久URL,需要在OSS桶中设置文件为公共读

|

||||

url = bucket.sign_url('GET', object_name, 3600)

|

||||

print(f"生成OSS文件URL: {url}")

|

||||

|

||||

return url

|

||||

|

||||

except Exception as e:

|

||||

print(f"文件上传失败: {e}")

|

||||

import traceback

|

||||

traceback.print_exc()

|

||||

return None

|

||||

|

||||

def make_bucket_public(bucket_name, access_key_id, access_key_secret, endpoint='https://oss-cn-beijing.aliyuncs.com'):

|

||||

"""

|

||||

设置OSS桶为公共读

|

||||

:param bucket_name: OSS桶名称

|

||||

:param access_key_id: 阿里云AccessKey ID

|

||||

:param access_key_secret: 阿里云AccessKey Secret

|

||||

:param endpoint: OSS端点,默认为北京区域

|

||||

:return: 是否设置成功

|

||||

"""

|

||||

print(f"开始设置OSS桶为公共读: {bucket_name}")

|

||||

|

||||

try:

|

||||

# 创建OSS客户端

|

||||

auth = Auth(access_key_id, access_key_secret)

|

||||

bucket = oss2.Bucket(auth, endpoint, bucket_name)

|

||||

|

||||

# 设置桶的访问策略为公共读

|

||||

policy = """

|

||||

{

|

||||

"Version": "1",

|

||||

"Statement": [

|

||||

{

|

||||

"Action": ["oss:GetObject"],

|

||||

"Effect": "Allow",

|

||||

"Principal": ["*"],

|

||||

"Resource": ["acs:oss:*:*:{bucket_name}/*"],

|

||||

"Condition": {}

|

||||

}

|

||||

]

|

||||

}

|

||||

""".format(bucket_name=bucket_name)

|

||||

|

||||

bucket.put_bucket_policy(policy)

|

||||

print(f"OSS桶设置为公共读成功: {bucket_name}")

|

||||

return True

|

||||

|

||||

except Exception as e:

|

||||

print(f"OSS桶设置失败: {e}")

|

||||

import traceback

|

||||

traceback.print_exc()

|

||||

return False

|

||||

738

tools/tongyi/20260207_134948_merged.md

Normal file

738

tools/tongyi/20260207_134948_merged.md

Normal file

@@ -0,0 +1,738 @@

|

||||

# 拼合内容

|

||||

|

||||

生成时间: 2026-02-07 13:49:48

|

||||

|

||||

我现在再给大家介绍一下,这个三角洲行动中的这个全局光照方案。

|

||||

|

||||

来自天美第三工作室引擎技术组的魏东陈。

|

||||

|

||||

讲之前我还是先自我介绍一下,我是15年加入的腾讯,然后最早是参加了乐高无限的开发。

|

||||

|

||||

到了天美之后,是先后参与了这个穿越火线手游,然后绝地求生、全军出击,还有这个CODM。

|

||||

|

||||

对我们现在的这个三角洲行动。

|

||||

|

||||

先看一下三角洲行动的这个总体画面效果。

|

||||

|

||||

|

||||

|

||||

我今天会按照这一个顺序,我先简单介绍一下项目,我会把常见的GI方案给罗列出来。

|

||||

|

||||

再根据三角洲行动这个项目,我们来看一下这个项目到底怎样进行一个技术选型,把这个完整的方案给讲一下。

|

||||

|

||||

项目现在已经累积了很多的DAU了。

|

||||

|

||||

他第一天开始,我们就希望尽量支持广泛的平台,然后大家一起爽玩。

|

||||

|

||||

|

||||

|

||||

所有地图都是单手通发的,就不会说只有一个地图就是在某一个特定平台上才发布,就不会这样。

|

||||

|

||||

每一个地图来说,就是要求玩家可见的这个区域,我们全都有全局光照的覆盖。

|

||||

|

||||

带来一些挑战,大家看就是要求所见的区域全都有这个GI的覆盖。

|

||||

|

||||

|

||||

|

||||

C和这个手机这是性能差异很大的的平台。

|

||||

|

||||

你选这个GI方案,肯定是有一些拉扯的那我们还是先把所有的GI方案都回顾一下,然后我们再看看根据这个双端的体系到底该怎么选择。

|

||||

|

||||

|

||||

|

||||

是light map,这是最简单和最传统最节省的方案。

|

||||

|

||||

还有就是像这个volume GI,这个是在PC上可以稀疏化存储的这种光照体质体素数据,它又有高精度,它又显存控制得住是吧?

|

||||

|

||||

|

||||

|

||||

像刺客信条、孤岛惊魂这类游戏都非常广泛的用了。

|

||||

|

||||

你像手游上这种就是有3D纹理,规整3D纹理的这个volume DI。

|

||||

|

||||

|

||||

|

||||

它有3D纹理,所以说它寻址采样就是比较GPU友好,就节省性能。

|

||||

|

||||

还有就是像以鲁曼为代表的这个全动态的,它效果又好的,美术迭代效率又高。

|

||||

|

||||

你看这些方案里,如果咱们比运行是性能的话,如果从性能的角度讲,那light map它肯定是最好的,对吧?

|

||||

|

||||

|

||||

|

||||

给你给一个2U然后就把这个数据,把这个有微电子给采出来了,然后GI的数据就得到了,就非常的高效。

|

||||

|

||||

美术可以在局部增大这个light map的文字密度,就得到很高的精度。

|

||||

|

||||

|

||||

|

||||

volume GI的话,它这里是以这种稀疏化存储的GI为例子,它这个数据存储获取就稍微麻烦一点。

|

||||

|

||||

就得在shader里去访问一个树形的体系结构,然后根据这个position去查询到这个光照,最后再还要根据法线去做一个解码。

|

||||

|

||||

可你可能又保存了这个SH或者是MND cube这种结构,那这样的话它消耗当然是比lad mab要大一些,但是还是可以接受了。

|

||||

|

||||

从我们经验看,就是说你660显卡就跑一个1080P下跑一个16G那3毫秒以内是没有问题的。

|

||||

|

||||

对于全动态DI像是roman d这个是没有办法,因为它迭代效率它是非常高的。

|

||||

|

||||

毕竟它是个全动态的效果,这那的pass的数量就比前两种都多了一个数量级。

|

||||

|

||||

是比运行是性能,但是咱们如果比项目成本的话,light bank你虽然效率高,但是你它的项目成本也非常高。

|

||||

|

||||

|

||||

|

||||

要制作这一堆2U而且这个麦氏和这个光照不解耦,做起来非常搞人心态的事儿。

|

||||

|

||||

你一个match到底在哪些地方要分配更多的文素,那迭代起来也绝对就是一个时间黑洞。

|

||||

|

||||

的地图,比如说像这个长空系统。

|

||||

|

||||

|

||||

|

||||

这全都铺上来的,不是你看你看这个框的数量,这根本就是一个不可能的事情。

|

||||

|

||||

相比之下,这volunt这就舒服多了是吧?

|

||||

|

||||

|

||||

|

||||

这没有2U这个烦恼,你迈出和光照解耦,运行师给定一个position之后,立刻就可以有根据算法查到自己所需要的这个数据。

|

||||

|

||||

像这种大范围的这长工这种地图,如果你用volume GI,你甚至可以用一个自动化的流水线,就每天进行不停的进行滚动烘焙。

|

||||

|

||||

只需要拉一下数据就可以得到你所需要的光照,对不对?

|

||||

|

||||

|

||||

|

||||

比如这个项目成本,就是像luman还有这些全能快捷,他把这个制作成本已经加压缩到接近为零,没有任何等待对吧?

|

||||

|

||||

在这样一条光谱上大家看越靠近左边,它这个运行时效率越高,但是制作成本也越高越靠近右边,它这个开发者越爽,迭代也越快,但是性能消耗也越大。

|

||||

|

||||

多方案里,三角洲行,我跟大家说就全都用了全都用了。

|

||||

|

||||

|

||||

|

||||

你大家听昨天的远光八四的分享,还有你如果去看那个COD的分享,大家都是在这一条光谱上都做出了个自己,就是几乎全都用了。

|

||||

|

||||

认为这可以是一种可以说这叫一种趋同进化了。

|

||||

|

||||

还是看一下这个双端它对GI到底是怎样一个需求呢?

|

||||

|

||||

|

||||

|

||||

C这边我们希望当然说是拔高效果,那不用说,但是你不论是lead mp还是vollied MGI,尤其是vollied GI你这精度一旦上去之后,那显存就会出现一个几何级别的增长,对不对?

|

||||

|

||||

PC这边所以你就要时刻提醒自己,就是说如何控制显存。

|

||||

|

||||

C的match它也更加复杂。

|

||||

|

||||

PC match上搞这个light map,那这个制作成本会更大。

|

||||

|

||||

就希望就更加希望往里面嚼,把它这个制作成本降低这个优势给发挥出来,所以说这里打了四颗星代表对他的一个期待。

|

||||

|

||||

这边大家可能想不到,就是对于GI系统或者说对所有的系统,首要的要求就是你要把这个包量给我降下来,对吧?

|

||||

|

||||

体保证手游玩家体验的一个非常重要的一环。

|

||||

|

||||

无脑的全都铺了个light map,那包量就会过于庞大。

|

||||

|

||||

你这还有TOD的这么一个情况下,手游的性能比PC弱很多,所以你要控制好消耗。

|

||||

|

||||

你要注意大多数其实它就是普遍手游一个情况,就是GPU瓶颈。

|

||||

|

||||

如果你有这个的方案的话,你这个消耗就不要比这个live map增长太多。

|

||||

|

||||

我们对他的这样一个期望。

|

||||

|

||||

受限于性能的话,手游的这个light map使用范围确实还是要更大一些。

|

||||

|

||||

然后我们这个选用原则就是说我们希望各个平台上都要优先保证运行效率。

|

||||

|

||||

|

||||

|

||||

不是说什么2K60FPS,因为多人竞技,你最好要上个120、130、100 44这种,然后在此基础上尽量的提高这个制作速度。

|

||||

|

||||

多人体图端我们都用了light map加volume GI的这个组合方案。

|

||||

|

||||

TC上这个volume I用的就是更多一些。

|

||||

|

||||

战役的话,因为没有PVP竞技的情况下,就直接用鲁本拔高效果。

|

||||

|

||||

它这个迭代效率高,事实上能达到更好的一个品美术品质。

|

||||

|

||||

我们先看这个PCR这个light map,我先说一下这个light map Baker,这是我们自己研的一个ggs红莓器,从CF手游就开始用了,然后一直迭代一直用到三角洲行动,现在已经是一个基于GPU的这样一个烘焙器。

|

||||

|

||||

|

||||

|

||||

map这个东西可以说让人真是又爱又恨,它这个效率品质都很好。

|

||||

|

||||

它场景到了之后,离线制作的这个也是非常吞噬时间的一个东西。

|

||||

|

||||

又在希局部希望很拉高精度的地方,就还是用了这个light map。

|

||||

|

||||

最大的这个长空地图,只有这些标记为浅绿色的地方是用了light map。

|

||||

|

||||

light map上面只有只有人工光和天光的可见度。

|

||||

|

||||

map它主要是负责室内光照,可以说这也可以让可以让各地图制作局部的各个切块之后,各个美术同志他可以独立的进行烘焙,它不受整体太阳光照方向变化调整的影响。

|

||||

|

||||

大地图使用lid map的,它的主要限制就是制作效率。

|

||||

|

||||

|

||||

|

||||

如果像长虹那种地图,你用了lid map之后全都用lid map,那你可能就是这地图永远就发布不了,尤其你还有这个TOD的情况下。

|

||||

|

||||

就来看一下PC上覆盖范围最大的这么一个部分,就是它这个volume键,这是我们的重点。

|

||||

|

||||

|

||||

|

||||

最大的好处就是大幅的提升了制作效率品质,也能接进来的map。

|

||||

|

||||

从这个防漏光基础的数据元素,然后存储、拟合、压缩,最后到全世界方案的这样一个顺序来介绍一下这个GI的方案。

|

||||

|

||||

还是这里我就先得提一句,如果你准备开始用volume MGI之后,它就有一个非常隐私的陷阱。

|

||||

|

||||

|

||||

|

||||

就是经历那么几个项目你才能得出来的这么一个经验。

|

||||

|

||||

看这个函数图表,横轴代表制作代价,纵轴代表这个GI方案的综合效果。

|

||||

|

||||

效果就是指画面加运行效率,综合起来这种效果大家看在这个点,这是light map,它有很高的制作代价,但是它的综合效果也确实很好。

|

||||

|

||||

理想中的volume jr是什么?

|

||||

|

||||

应该是大幅提升制作效率,对不对?

|

||||

|

||||

代价大幅下降,但是它的综合效果下降很小,这是理想中的王俊杰。

|

||||

|

||||

就非常容易进去一个陷阱什么的。

|

||||

|

||||

搞的这种就是你做出来之后确实和麦是解耦了,那程序觉得自己好厉害,然后美术由于工作负担下降,他也觉得很开心。

|

||||

|

||||

你别忘了,这就是volume GI他自己也有像是漏光这种固有问题。

|

||||

|

||||

问题如果处理不好就集中,极易造成制作成本虽然下降了,但是画面也有一点下降。

|

||||

|

||||

有一点漏光瑕疵等等,或者说你画面没有下降,程序性能大幅下降。

|

||||

|

||||

比如说你运行时必须花一个大代价去解决这个漏光问题。

|

||||

|

||||

volume GI相对于这个light map来说,大家发现没有,它的总的性价比并没有大的变化。

|

||||

|

||||

制作团队在做这个东西的时候,它就各有各的爽点。

|

||||

|

||||

前面说了就是说对此对这个性价比提升就是感知不强。

|

||||

|

||||

最恐怖的时候,就当这个测试回单的时候,要么发现你这个东西效率不太好,要么发现画面有一些什么瑕疵之类的,然后产生很多很多bug的。

|

||||

|

||||

为了修复这些bug,又得去各种hack解决,反复折腾,然后把这个volley GI的清低成本的优势给搞没了。

|

||||

|

||||

就是我见过一些项目是进入过这个陷阱的这也是经历了一些就是这样一些经验教训,然后才我们才开始特别重视这个事情。

|

||||

|

||||

所以我先提防漏光,就是防漏光。

|

||||

|

||||

|

||||

|

||||

volleyer之间从项目角度讲能否成功的一个关键因素。

|

||||

|

||||

我因为我们就要追求高性价比,甚至我可就是漏光,它是一个volume GI就常有的一个瑕疵。

|

||||

|

||||

这个体素的宽度比这个墙厚的时候,那漏光就可能产生你踩踩的踩到墙对面去,对不对?

|

||||

|

||||

什么时候这个漏光根本就无法预测的话,那制作组来bug单就会非常多。

|

||||

|

||||

这种拉扯很很可能就把这个制作优势,这个制作成本低这个优势给抵消掉。

|

||||

|

||||

这个方案必须本身必须能斩钉截铁的告诉美术,美术同事就说你怎么制作才能完全避免漏光。

|

||||

|

||||

起来简单的话,那也是真简单,就是把这个体速精度给尽量的提高,但你就别超过性能的预算。

|

||||

|

||||

|

||||

|

||||

行动里面是0.25米。

|

||||

|

||||

告诉美术同事,就是说所有的墙只要超过0.25米,厚度超过0.25米,它就一定不漏光。

|

||||

|

||||

0.25米对于大多数几何体来说,这是一个可以接受的方案。

|

||||

|

||||

运行时三星应用插值的时候,你那你无论说都不可能踩到墙面后墙后面去,对不对?

|

||||

|

||||

这个体你你这个墙比体塑要厚,那如果实在碰上必须小于0.25的,比如说铁皮房咱们再想hack的办法。

|

||||

|

||||

你存在这样一个非常清晰的标准,然后就能从制作层面比规避大多数绝大多数漏光。

|

||||

|

||||

这件事你必须从项目第一天就开始做,否则那你只能运行时去搞个什么算法去防漏光了。

|

||||

|

||||

做一个什么世界空间的那个奔驰刀等等。

|

||||

|

||||

|

||||

|

||||

每一个提速来说,我们还是看一下的基础的数据元素是什么。

|

||||

|

||||

体系就存一个六个方向的irregular的这个amin cube,其实就是半成明二以来非常经典的一个结构。

|

||||

|

||||

使命召使命召唤黑色行动系列也用了这个结构。

|

||||

|

||||

运行时是根据法线从这个六个方向里插值得到这个最终结果。

|

||||

|

||||

必须看一下,就是这个0.25它是一个很高的密度,比较高的精度。

|

||||

|

||||

|

||||

|

||||

用这个规整的3D纹理去存的话,这显存很快就炸了,轻松给你上8个G16个G所以就需要一个稀疏化存储的方案,就是越靠近mesh我才存储高精度的提速。

|

||||

|

||||

|

||||

|

||||

0.25米这么高精度的东西最好只贴着静态mesh版。

|

||||

|

||||

我们去读虚幻引擎自带的open VDB的存储代码的时候,我们就参考它实现了一个比较高效的方案。

|

||||

|

||||

open VDB它其实也是这个胡迪尼的一个核心组件,提渲染就是很核心的一个组件。

|

||||

|

||||

|

||||

|

||||

看就是这个数据块,它横向大小为64乘64,这是我们一个离线分块存储,每一个数据块就是这么大,这就是GI的数据。

|

||||

|

||||

每个数据块内部,我按照以4米为精度存储规整的粗糙的体素元素。

|

||||

|

||||

个体数个头大,它这个数量可以虽然它是一个规整的这么一个结构,大家看这就是这些黄色的体素,对于每一个4米的这个提速,我给它各个维度除以4,然后分裂产生64个这种1米宽度的提速,就这些蓝色的提速。

|

||||

|

||||

|

||||

|

||||

这一次我就要求这些蓝色的这一米提速,你必须得靠保只保留那些靠近麦是足够近的,加个阈值。

|

||||

|

||||

|

||||

|

||||

这里是3米,大家看远处的都舍弃掉了,然后再来一次继续分裂这种一米的体素,然后形成0.25米的体速。

|

||||

|

||||

|

||||

|

||||

这次再压缩阈值,要求只保留距离面试表面很近的0.3米的体速,你看这基本就贴着卖是摆了一层。

|

||||

|

||||

我们就可以形成一个逻辑上的,就是从上到下的这样一个数据结构,一个树形结构。

|

||||

|

||||

|

||||

|

||||

其实是个六十四叉树,类似这个图。

|

||||

|

||||

我们手机节点确实是从4米开始的,我们没有一个实际上的根节点。

|

||||

|

||||

给定一个word position之后,我们怎么定位说这个word position到底对应到哪个0.25米高精度提速上呢?

|

||||

|

||||

还是我们去参考open ABDB实现了这样一个算法,就是我们先把这个提速数给按照广度优先便利给便利一遍,然后形成一个序列。

|

||||

|

||||

|

||||

|

||||

用二叉树做了一个示例。

|

||||

|

||||

一个word position之后,怎么快速知道所需求的这个光照数据究竟在这个序列中哪个位置呢?

|

||||

|

||||

在每一个数字节点中,我们定义一个64 bit的exist mask,就是一个bit mask。

|

||||

|

||||

表示出每个节点的64个子节点当中,究竟哪些子节点是保留了的,一代表保留,零代表这个子节点距离max太远就给舍弃掉了。

|

||||

|

||||

对于这个bit mask实际上相当于一个小型的局部正方体,它包含了规整的4乘4个,一共有64个子节点是否存在的这么一个情况。

|

||||

|

||||

一个子节点只要给定相对于父节点的这个局部坐标,就可以快速对应到究竟就自己究竟是bit mask里面究竟哪一个bit。

|

||||

|

||||

你得知道如果你这个子节点是保留了的,比如说是这个一对不对,那它是第几个子节点呢?

|

||||

|

||||

你只要数这个bit max,从开头到你这个一共经历了多少个一。

|

||||

|

||||

正好C端里面有一条一个叫count base的指令,一条指令就可以帮你做好这个事情。

|

||||

|

||||

节点里我再保存好这个节点在第一个子节点的下标,比如说这是比如说就这是M再把count face的这个结果给加上来。

|

||||

|

||||

是2,那你就可以得到M加2。

|

||||

|

||||

这样就是用很低的代价就可以获得这个子节点在这个数里面这个下标,这里其实利用了一下这个BFS这个性质,就是说一个节点的子节点,它必定在这个序列中连续梦回大邑,然后你最多重复三次这个过程,直到访问或者miss。

|

||||

|

||||

按照这个顺序的这个序列这个顺序我们再把它对应的这个光照的这这个序列也给排布出来。

|

||||

|

||||

只要获得到任何一个position,只要查到了自己在树中的这个下标,就可以查到自己在这个光照序列中的下边,然后直接取用这里的数据就可以了。

|

||||

|

||||

当然运行是你要去采样八次,因为你要做三星星差值。

|

||||

|

||||

因为有大量的这种硬件方面的指令的支持,所以说这个访问速度其实它是很快的OK但是经过刚才这样的稀疏存储,总体体积依然是比较大的那毕竟每个尺寸它有48个bit,对不对?

|

||||

|

||||

|

||||

|

||||

一个六个方向的一个EAM and cube,那我们希望这个体积还是再小一点。

|

||||

|

||||

你相邻的体速,大家看相邻体速光照这个数值是接近的那我们希望再做一点压缩的处理,另外地图是支持TOD的,对不对?

|

||||

|

||||

个体数上可能存储更多的数据。

|

||||

|

||||

我们希望就是每个体数上存储的体积不要受总时段增长的影响。

|

||||

|

||||

为了你和压缩,我们还是要做点准备工作。

|

||||

|

||||

|

||||

|

||||

还是调用这个open ADB给这个场景,沿着match表面生成一层pro作为这个支撑点数据,这些probe的密度会远比那些提速要稀疏。

|

||||

|

||||

proof上给它烘焙一个48 bt的MN的cube。

|

||||

|

||||

如果有多个时段,比如说一天有八个时段,那你那你就烘焙8份就存储这八份儿都存储在这个数这个游戏包里。

|

||||

|

||||

probe你可以控制的很稀疏,这些东西它上面的数据它不怕那个数据多。

|

||||

|

||||

希望每一个体数上,就是它存储的这个数据量远小于原生的48倍数据量,并且不随着时段增长而增长。

|

||||

|

||||

|

||||

|

||||

就可以用距离它最近的四个problem上的m and cube去做一个线性的组合,把这个原生的结果给拟合出来。

|

||||

|

||||

这我其这就是我们希望让这个高纬度的向量上,就是48倍的那些很很好的向量,让这些稀疏的probe去存储。

|

||||

|

||||

这些密集的体素只需保存,只去组合它们就可以了。

|

||||

|

||||

每个密集的体系上就只需要存储四个index加四个float,这样只有恒定的16个bit,那就比48小多了。

|

||||

|

||||

这个相邻的提速的这个index也。

|

||||

|

||||

一样的,那就很容易利用类似游程编码的方式进行进一步的压缩,但这个就不能展开讲了,就时间比较有限OK那令所有提速的这个权重,还有就是所有的这些绿色节点发出来,这些红色的这些边,就他们所有的这权重,还有令所有pro 5上的这些支撑点的这些数据,都可以作为变量变化。

|

||||

|

||||

|

||||

|

||||

就希望调整这些所有的这些数据变化,然后让每一个体素上线性组合出来的这个数值与原生数值这个差尽量的小。

|

||||

|

||||

用的是差的平方的形式,因为它好求导,然后我们就希望把所有这些差的平方加起来,就这个平方和让它尽量的小,这就是一个全局优化的问题。

|

||||

|

||||

|

||||

|

||||

看似不好解决,但是这个函数无论是对于权重还是对于上的这个数值,都很容易把这个偏导数给写出来。

|

||||

|

||||

这就容易多了,对不对?

|